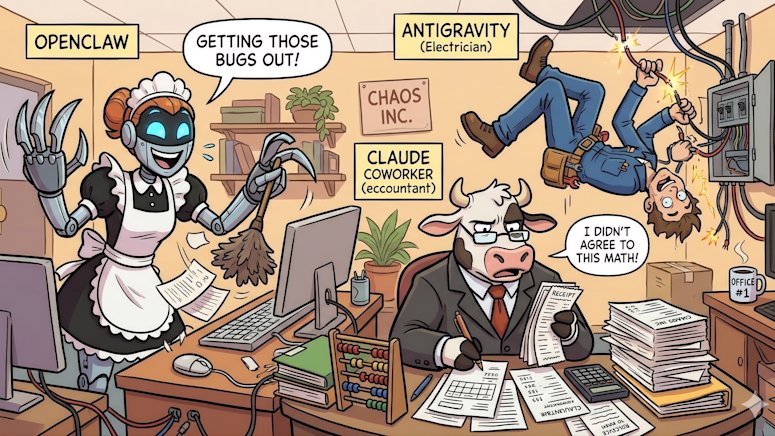

Эпоха автономных AI-агентов наступила. То, что началось в 2022 году с простого общения с ChatGPT, превратилось в серьёзные дискуссии о будущем работы и возможном появлении искусственного общего интеллекта (ИОИ). Особенно эти опасения усилились с выходом мощных автономных систем, таких как Claude Cowork и OpenClaw.

Новое поколение AI-помощников

OpenClaw (ранее известный как Moltbot и Clawdbot) за несколько дней набрал более 150 000 звёзд на GitHub. Этот инструмент уже развёртывается на локальных машинах с глубоким доступом к системе. По сути, это цифровая «горничная», которой вы вручаете ключи от своего дома — она управляет файлами и данными, чтобы выполнять задачи: сортировку входящих писем, автоответы, подбор контента, планирование поездок и многое другое.

Antigravity от Google — это агент для программирования со встроенной IDE, который ускоряет путь от идеи до рабочего продукта. С его помощью можно интерактивно создавать целые проекты приложений и вносить правки отдельными запросами. Это похоже на работу с junior-разработчиком, который умеет не только писать код, но и собирать, тестировать, интегрировать и исправлять ошибки.

Claude от Anthropic усилил свои позиции с выходом Cowork — агентов для автоматизации юридических задач, таких как проверка контрактов и сортировка NDA. Это вызвало резкое падение акций юридических технологических компаний и SaaS-решений. Claude теперь обладает глубокими знаниями в конкретных областях, таких как право и финансы, подобно опытному бухгалтеру, который разбирается в налогах и управлении счетами.

Риски и возможности

Эффективность этих инструментов напрямую зависит от уровня предоставленных им полномочий, что одновременно увеличивает риски. Пользователям приходится доверять таким компаниям, как Anthropic и Google, полагая, что их агенты не нанесут вред, не допустят утечки данных и не предоставят нечестных преимуществ. OpenClaw, будучи open-source решением, усложняет ситуацию, поскольку у него нет центрального управляющего органа.

Хотя эти технологические достижения впечатляют и созданы для общего блага, достаточно одного-двух инцидентов, чтобы вызвать панику. Ошибка агента-программиста может привести к внедрению некорректного кода или созданию скрытых уязвимостей. Cowork может упустить возможности для налоговой оптимизации или, что хуже, включить незаконные списания. Claude с расширенными полномочиями способен нанести непредсказуемый ущерб.

Как обуздать хаос

В этом хаосе скрывается и огромная возможность. При правильных ограничительных рамках агенты могут фокусироваться на конкретных действиях, избегая случайных и неподотчётных решений. Крайне важны принципы ответственного ИИ: подотчётность, прозрачность, воспроизводимость, безопасность и конфиденциальность.

Необходимо вести журнал всех шагов агента и предусматривать подтверждение действий человеком в критических моментах. Кроме того, поскольку агенты взаимодействуют с множеством различных систем, им важно «говорить на одном языке».

Здесь на первый план выходит онтология — она позволяет отслеживать, контролировать и учитывать события. Общая предметно-ориентированная онтология может определить «кодекс поведения» для агентов. Этические принципы, объединённые с общей системой доверия и распределённой идентификацией, позволяют создавать системы, в которых агенты выполняют по-настоящему полезную работу.

Правильно выстроенная экосистема автономных агентов способна значительно снизить когнитивную нагрузку на человека, освободив рабочую силу для решения задач более высокой ценности. Люди получат выгоду, когда рутинные операции будут делегированы искусственному интеллекту.