Любой кластер графических процессоров периодически простаивает. Обучение моделей завершается, рабочие нагрузки меняются, а оборудование бездействует, в то время как затраты на электроэнергию и охлаждение продолжают расти. Для операторов неклассических облачных платформ (неоклаудов) такие простои означают прямые убытки.

Традиционным решением являются спотовые рынки GPU — аренда свободных мощностей всем желающим. Однако в этом случае облачный провайдер всё равно выступает в роли арендодателя, а инженеры платят за «голые» вычислительные ресурсы без готового стека для инференса. Компания FriendliAI предлагает иной подход: запускать задачи инференса напрямую на неиспользуемом оборудовании, оптимизировать систему под пропускную способность по токенам и делиться выручкой с оператором.

От университетской лаборатории к промышленному стандарту

FriendliAI была основана Бён-Гоном Чуном, исследователем, чья работа по непрерывному батчингу (continuous batching) легла в основу vLLM — популярного открытого движка для инференса, используемого сегодня в большинстве промышленных развёртываний. Более десяти лет Чун был профессором Сеульского национального университета, изучая эффективное выполнение машинного обучения в больших масштабах.

Это исследование привело к созданию научной работы под названием Orca, которая представила метод непрерывного батчинга. Технология динамически обрабатывает запросы на инференс вместо того, чтобы ждать заполнения фиксированного батча. Теперь это отраслевой стандарт и ключевой механизм внутри vLLM.

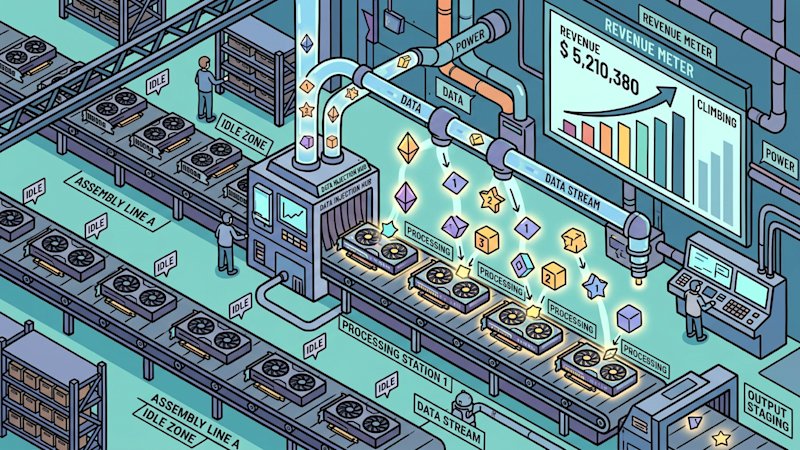

InferenceSense: AdSense для неиспользуемых GPU

На этой неделе FriendliAI запускает новую платформу под названием InferenceSense. Подобно тому, как издатели используют Google AdSense для монетизации нераспроданной рекламной инвентаризации, операторы неоклаудов могут с помощью InferenceSense заполнять свободные циклы GPU платными задачами ИИ-инференса и получать долю от выручки за токены. Собственные задачи оператора всегда имеют приоритет — как только планировщик запрашивает GPU обратно, InferenceSense освобождает ресурсы.

«Мы предоставляем возможность вместо простоя GPU монетизировать их, запуская инференс», — пояснил Чун.

Как это работает

InferenceSense работает поверх Kubernetes, который большинство операторов уже используют для оркестрации ресурсов. Оператор выделяет пул GPU в кластер Kubernetes, управляемый FriendliAI, указывая, какие узлы доступны и при каких условиях их можно вернуть. Обнаружение простоя осуществляется через сам Kubernetes.

«У нас есть собственный оркестратор, который работает на GPU этих неоклауд- или просто облачных вендоров, — сказал Чун. — Мы определённо используем преимущества Kubernetes, но программное обеспечение, работающее поверх, — это высокооптимизированный стек для инференса».

Когда GPU не используются, InferenceSense запускает изолированные контейнеры, обслуживающие платные задачи инференса на открытых моделях, включая DeepSeek, Qwen, Kimi, GLM и MiniMax. Когда планировщику оператора требуется вернуть оборудование, задачи инференса приостанавливаются, а GPU освобождаются. По заявлению FriendliAI, передача управления происходит за считанные секунды.

Спрос агрегируется через прямых клиентов FriendliAI и агрегаторов инференса, таких как OpenRouter. Оператор предоставляет мощности; FriendliAI занимается привлечением спроса, оптимизацией моделей и стеком обслуживания. Никаких предоплат и минимальных обязательств нет. В реальном времени операторы видят на дашборде, какие модели работают, сколько токенов обрабатывается и какая выручка накапливается.

Почему пропускная способность токенов лучше аренды мощностей

Спотовые рынки GPU от таких провайдеров, как CoreWeave, Lambda Labs и RunPod, подразумевают, что облачный вендор сдаёт в аренду собственное оборудование третьей стороне. InferenceSense работает на оборудовании, которым оператор уже владеет, причём оператор сам определяет участвующие узлы и заранее устанавливает правила планирования с FriendliAI. Это ключевое отличие: спотовые рынки монетизируют мощность, а InferenceSense монетизирует токены.

Доход за период простоя определяет пропускная способность по токенам на GPU-час. FriendliAI заявляет, что её движок обеспечивает в два-три раза большую пропускную способность, чем стандартное развёртывание vLLM, хотя Чун отмечает, что показатель зависит от типа рабочей нагрузки.

Большинство конкурирующих стеков для инференса построены на Python-фреймворках с открытым исходным кодом. Движок FriendliAI написан на C++ и использует собственные GPU-ядра вместо библиотеки Nvidia cuDNN. Компания создала собственный слой представления моделей для их разделения и выполнения на оборудовании, а также свои реализации спекулятивного декодирования, квантования и управления KV-кэшем.

Что это значит для инженеров по ИИ

Для инженеров, выбирающих, где запускать задачи инференса, выбор между неоклаудом и гиперскалером обычно сводился к цене и доступности.

InferenceSense добавляет новый фактор: если неоклауды смогут монетизировать простой через инференс, у них появится больше экономических стимулов для поддержания конкурентных цен на токены.

Это не повод менять инфраструктурные решения уже сегодня — технология ещё молода. Но инженерам, отслеживающим общую стоимость инференса, стоит наблюдать, приведёт ли внедрение платформ вроде InferenceSense неоклаудами к снижению цен на API-доступ к моделям, таким как DeepSeek и Qwen, в течение следующих 12 месяцев.

«Когда у нас появляются более эффективные поставщики, общая стоимость снижается, — сказал Чун. — С InferenceSense мы можем помочь сделать эти модели дешевле».